یکپارچهسازی دادهها: اهمیت، مزایا، چالشها و کاربردها

در دنیای امروز، یکپارچهسازی دادهها به عنوان یکی از ارکان اساسی موفقیت سازمانها در مدیریت و استفاده بهینه از دادهها شناخته میشود. مقالهای که پیش رو دارید، بهطور جامع به بررسی مفهوم و فرایند یکپارچهسازی دادهها پرداخته و اهمیت این فرایند را در صنایع مختلف توضیح میدهد. در این مقاله، شما با ابعاد مختلف این موضوع، از جمله ارتباط آن با هوش مصنوعی، انواع روشهای یکپارچهسازی دادهها، ابزارهای کاربردی و چالشهای پیشرو آشنا خواهید شد. همچنین مزایای یکپارچهسازی دادهها، از جمله بهبود کیفیت دادهها، افزایش کارایی، سرعت عمل و نوآوریهای دادهمحور نیز مطرح میشود.

این مقاله به شکلی ساختاریافته به شما کمک میکند تا درک بهتری از این فرآیند پیچیده پیدا کرده و چگونگی پیادهسازی آن در سازمان خود را بررسی کنید. شما با خواندن این محتوا به نکات کلیدی برای انتخاب ابزار و تکنیک مناسب برای یکپارچهسازی دادهها دست خواهید یافت. در نهایت، این مقاله بهعنوان راهنمایی مفید، مزایای اساسی و چالشهای این فرایند را در پیش روی شما قرار میدهد.

با این مقاله، به یک راهنمای جامع و کاربردی در زمینه یکپارچهسازی دادهها دست خواهید یافت که برای هر کسی که در حوزههای مختلف تکنولوژی، بازاریابی یا مدیریت داده فعالیت میکند، خواندنی و جذاب خواهد بود.

برای آشنایی و استفاده از هوش مصنوعی تصویر ساز کلیک کنید

یکپارچهسازی دادهها چیست؟ – توضیح ساده Data Integration

در دنیای دیجیتال امروز، کسبوکارها تنها زمانی میتوانند به فعالیت خود ادامه دهند که بتوانند دادههای مورد نیازشان را از منابع مختلف مانند پایگاههای داده، نرمافزارها و سرویسهای ابری گردآوری کنند. این دادهها اغلب از نظر قالب و مکان ذخیرهسازی متفاوت هستند و کیفیت و پایداری یکسانی ندارند. به همین دلیل، فرایندی به نام «یکپارچهسازی دادهها» (Data Integration) طراحی شده است. این فرایند با جمعآوری دادهها از منابع مختلف و تبدیل آنها به ساختاری یکپارچه، تجزیه و تحلیل و تصمیمگیری نهایی را سادهتر میسازد. در این مطلب، به طور کامل با مفهوم یکپارچهسازی دادهها آشنا میشویم.

در ابتدا به توضیح مفهوم یکپارچهسازی دادهها و ارتباط آن با هوش مصنوعی میپردازیم. سپس نحوه عملکرد و روشهای اجرای این فرایند را بررسی میکنیم و انواع و ابزارهای مختلف آن را معرفی خواهیم کرد. در پایان، با ارائه مثالهایی کاربردی، نگاهی به مزایا، چالشها و کاربردهای یکپارچهسازی دادهها خواهیم داشت.

مفهوم یکپارچهسازی دادهها چیست؟

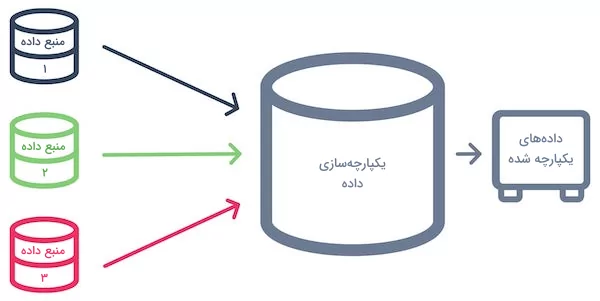

«یکپارچهسازی دادهها» (Data Integration) به فرایندی گفته میشود که طی آن دادههای جمعآوری شده از منابع مختلف با یکدیگر ترکیب میشوند تا یک مجموعه اطلاعات واحد و منسجم ایجاد شود. هدف از این فرایند، ساختن یک «مجموعهداده» (Dataset) تمیز و کارآمد است که نیازهای عمده کاربران را برآورده کند. یکپارچهسازی دادهها همچنین برای بهبود عملکرد مدلهای یادگیری ماشین ضروری است. با ترکیب دادههای گوناگون و تضمین کیفیت آنها، این فرایند نقشی اساسی در حوزه هوش مصنوعی و آموزش مدلهای یادگیری ماشین ایفا میکند.

ارتباط میان هوش مصنوعی و یکپارچهسازی دادهها چیست؟

اکنون که مفهوم یکپارچهسازی دادهها را درک کردیم، بررسی رابطه این فرایند با هوش مصنوعی و تأثیر آن بر عملکرد سیستمهای هوشمند نیز اهمیت دارد. یکپارچهسازی دادهها بر کیفیت و گستره اطلاعاتی که برای آموزش و ارزیابی مدلهای یادگیری ماشین بهکار میرود، اثرگذار است. برخی از جنبههای اصلی این تأثیر عبارتاند از:

بهبود کیفیت دادهها: اجرای صحیح یکپارچهسازی دادهها تضمین میکند که ناهماهنگیها و مشکلات احتمالی دادهها پیش از ورود به الگوریتمهای یادگیری ماشین برطرف شده باشد. دادههای با کیفیت تأثیر چشمگیری در تولید پیشبینیهای قابل اعتماد و افزایش کارایی سیستمهای هوشمند دارند.

کاهش خطا و افزونگی: به دلیل تفاوت فرمت یا واحد اندازهگیری میان دیتاستهای مختلف، ممکن است دادهها ناسازگاریهایی داشته باشند. یکپارچهسازی دادهها با ادغام نمونهها از منابع مختلف، افزونگیها را حذف کرده و دیتاستی تمیز و منسجم برای آموزش مدلهای یادگیری فراهم میکند.

ترکیب دیتاستهای متنوع برای تجزیه و تحلیل: با یکپارچهسازی چندین دیتاست، الگوریتمهای هوش مصنوعی به اطلاعاتی جامعتر دسترسی پیدا میکنند. مدلهای یادگیری ماشین با استفاده از چنین دیتاستهای گستردهای میتوانند روابط پیچیده بین متغیرها را بهتر شناسایی کرده و نتایج دقیقتری ارائه دهند.

به طور کلی، یکپارچهسازی دادهها با ایجاد انسجام و ترکیب دیتاستهای متنوع به مدلی دقیقتر و مؤثرتر کمک میکند.

کارکرد یکپارچهسازی دادهها چیست؟

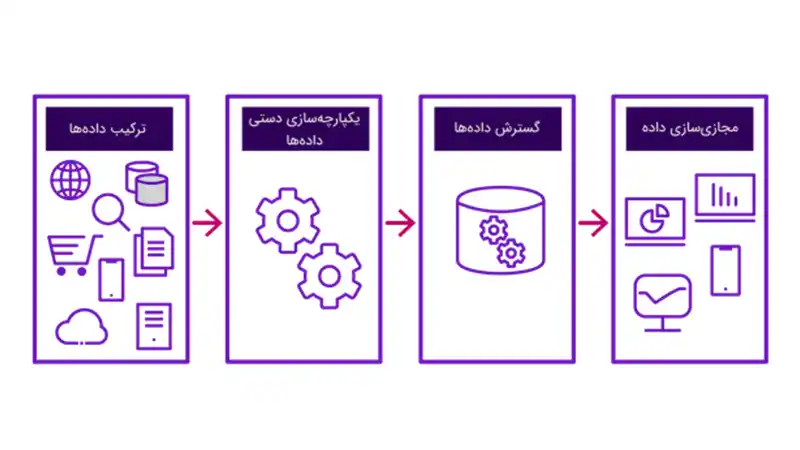

همانطور که پیشتر به مفهوم یکپارچهسازی دادهها پرداختیم، این فرایند شامل مراحلی است که دادههای جمعآوریشده از منابع مختلف را به شکلی منسجم و قابل استفاده تبدیل میکند. مراحل کارکرد یکپارچهسازی دادهها به شرح زیر است:

شناسایی منبع داده: اولین گام، شناسایی منابع داده مانند پایگاههای داده و سرویسهای ابری است که اطلاعات مورد نیاز را تأمین میکنند.

استخراج داده: پس از شناسایی منابع، دادهها باید به کمک ابزارهای مناسب از این منابع استخراج شوند.

نگاشت داده: به دلیل تفاوت در فرمت یا ساختار نمایش اطلاعات، لازم است طرحوارهای برای هماهنگی بین عناصر سیستمهای مختلف ایجاد شود.

ارزیابی داده و تضمین کیفیت: در این مرحله، دادهها از نظر دقت و کیفیت بررسی میشوند. تضمین کیفیت شامل بررسی خطاها و ناسازگاریها و حفظ انسجام دادهها است.

تبدیل داده: دادهها در این مرحله به ساختاری مشترک تبدیل میشوند. پاکسازی داده (Data Cleaning) و نرمالسازی داده (Data Normalization) از فرآیندهای اصلی این مرحله هستند.

بارگذاری داده: دادههای پردازششده در انبار داده (Data Warehouse) ذخیره میشوند تا در مراحل بعدی برای ارزیابی و تهیه گزارشها آماده شوند. این بارگذاری میتواند بهصورت دستهای (Batch) یا بلادرنگ (Real-time) انجام گیرد.

همگامسازی داده: برای حفظ یکپارچگی، دادهها باید بهصورت دورهای یا بلادرنگ بهروزرسانی شوند.

امنیت داده: بهکارگیری تکنیکهای امنیتی استاندارد برای محافظت از دادهها در برابر تغییرات ناخواسته و دسترسی غیرمجاز ضروری است.

مدیریت فراداده: فراداده (Metadata) به کاربران کمک میکند تا درک بهتری از منبع و محتوای دادهها داشته باشند.

دسترسی و تحلیل داده: پس از یکپارچهسازی، میتوان دادهها را تحلیل کرد و از نتایج آن برای تصمیمگیریهای مؤثر استفاده نمود.

به طور کلی، یکپارچهسازی دادهها با مجموعهای از فرایندها و ابزارها، هماهنگی، دقت و دسترسیپذیری دادهها را برای تجزیه و تحلیلهای مؤثر و تصمیمگیریهای معنادار فراهم میکند.

چگونه یکپارچهسازی دادهها را با فرادرس یاد بگیریم؟

در دنیای امروز که دادهها از منابع مختلف و با فرمتهای گوناگون گردآوری میشوند، یکپارچهسازی آنها به چالشی مهم اما ضروری تبدیل شده است. یکپارچهسازی دادهها به معنای ترکیب دادههای پراکنده از منابع مختلف و ایجاد یک ساختار واحد و منسجم است. پیش از شروع این فرایند، باید با انواع مختلف پایگاههای داده و ساختارهای منابع داده آشنا شوید.

گام بعدی، یادگیری پیشپردازش دادهها با ابزارهایی مثل زبان برنامهنویسی پایتون است. با کسب این دانش، میتوانید مهارتهای خود را در پروژههای واقعی و حوزههایی مانند یادگیری ماشین بهکار بگیرید. اگر به دنبال توسعه مهارتهای خود در این زمینه هستید، ما مجموعهای از فیلمهای آموزشی جامع و کاربردی را فراهم کرده ایم که میتوانید با دنبالکردن آنها به یادگیری اصول یکپارچهسازی دادهها بپردازید.

یکپارچهسازی دادهها چگونه انجام میشود؟

در روش سنتی یکپارچهسازی دادهها، کاربر درخواست خود را به یک سرور مرکزی ارسال میکند. سرور مرکزی نیز دادههای مورد نیاز را از منابع داخلی و خارجی جمعآوری کرده و مجموعهدادهای واحد را از ترکیب این اطلاعات ایجاد میکند. سپس این خروجی، برای استفاده کاربران در دسترس قرار میگیرد. با افزایش حجم دادههایی که روزانه توسط شرکتها جمعآوری میشود، سازمانها باید شیوههای مناسب برای استخراج و دسترسی به اطلاعات را به کاربران و کارکنان خود معرفی کنند. بهطور ساده، شرکتها باید بتوانند در هر لحظه به دادههای مورد نیازشان برای تحقق اهداف دسترسی داشته باشند.

دادههای مورد نیاز، در منابع متعددی از جمله نرمافزارها، دیتاستها، فضای ابری و دستگاههای مرتبط با اینترنت اشیا (IoT) پراکندهاند. سازمانها دیگر تمام دادههای خود را در یک پایگاه داده ذخیره نمیکنند، بلکه اطلاعات ساختیافته و بدون ساختار را در میان منابع مختلف توزیع میکنند. به عنوان مثال، ممکن است بخشی از اطلاعات شرکتی در فایلهای داخلی و بخش دیگر در سرویسهای ابری ذخیره شده باشد.

برای یکپارچهسازی دادهها دو روش رایج وجود دارد:

یکپارچهسازی فیزیکی و منطقی: در این روش، دادهها از یک منبع به منبع دیگر منتقل میشوند. طی این فرایند، عملیاتهایی نظیر پاکسازی، نگاشت و تبدیل دادهها پیش از جابهجایی انجام میشود تا مجموعهدادهای منسجم ایجاد شود.

مجازیسازی داده (Data Virtualization): این روش دسترسی به دادهها را بدون انتقال فیزیکی فراهم میکند. در اینجا، نمایی شبیهسازی شده از دادهها ایجاد میشود، و نیازی به انتقال حقیقی اطلاعات نیست.

هر دو روش بسته به نیاز و نوع دادههای سازمانها مورد استفاده قرار میگیرند تا دسترسی به اطلاعات جامعتر و سریعتر صورت گیرد.

ترکیب دادهها

در روش ترکیبی (Consolidation)، دادهها به شکل فیزیکی با یکدیگر ترکیب میشوند و نسخهای واحد از این دادهها تنها در یک مخزن ذخیره میشود. این رویکرد عمدتاً برای کاهش تعداد منابع ذخیرهسازی بهکار میرود و باعث میشود که دادهها به صورت یکپارچه و منسجم در دسترس باشند.

یکی از روشهای پشتیبانیکننده در ترکیب دادهها، رویکرد ETL است. در این روش، دادهها از چندین منبع مختلف استخراج (Extract) و پس از تغییر فرمت (Transform) به یک انبار داده یا پایگاه داده جدید منتقل (Load) میشوند. فرایند ETL تمامی مراحل آمادهسازی دادهها از جمله سازماندهی و تبدیل دادهها را پیش از انتقال به منبع جدید پیادهسازی میکند و به این ترتیب، امکان تجزیهوتحلیل دقیقتر و کارآمدتر اطلاعات را فراهم میسازد.

یکپارچهسازی دستی دادهها

روش یکپارچهسازی دستی دادهها، که شامل کدنویسی مراحل مختلف کار است، یکی از ابتداییترین استراتژیها برای یکپارچهسازی دادهها به شمار میآید. این روش تنها زمانی کارآمد است که با حجم کمی از دادهها سروکار داشته باشیم. یکی از مزیتهای این رویکرد، کنترل کامل بر مراحل جمعآوری، تغییر و یکپارچهسازی دادهها است.

هرچند این روش ممکن است در برخی هزینهها صرفهجویی کند، اما به دلیل فرایند زمانبر، میتواند مدت زمان یکپارچهسازی دادهها را طولانی کند و همچنین در مواجهه با منابع جدید یا حجم زیاد دادهها، چالشهایی ایجاد میکند.

گسترش دادهها

گسترش دادهها (Propagating Data) به معنای بهرهبرداری از نرمافزارهای مرتبط برای تکثیر اطلاعات از یک موقعیت به موقعیتی دیگر است. این فرایند معمولاً در سیستمهای رویداد محور (Event-driven) انجام میشود، جایی که تغییرات یا رویدادهای خاص موجب انتقال دادهها از یک منبع به منبع دیگر میشوند.

در این روش، بهمحض وقوع یک رویداد خاص، دادهها بهطور خودکار به سیستمهای مختلف منتقل یا بهروزرسانی میشوند، که این امر موجب بهبود کارایی و هماهنگی میان منابع مختلف داده میگردد.

مجازیسازی داده

مجازیسازی داده (Data Virtualization) این امکان را به کاربران میدهد که با وجود تقسیم اطلاعات در سیستمهای ذخیرهسازی مختلف، نمایی واحد از دادهها دریافت کنند. این فرآیند تنها یک لایه منطقی است که دادهها را از چندین منبع مختلف ترکیب کرده و نتیجه حاصل را بهطور آنی به کاربران انتقال میدهد.

مزیت اصلی مجازیسازی داده در این است که نیاز به انتقال فیزیکی دادهها را از بین میبرد. در این روش، دیگر نیازی به صرف هزینه اضافی برای منابع ذخیرهسازی نخواهد بود و اطلاعات بدون هیچ تغییری در مرجع اصلی خود باقی میمانند. این به سازمانها کمک میکند تا دادهها را بهطور موثرتر و با هزینه کمتر مدیریت کنند.

انواع مختلف یکپارچه سازی داده ها

تا اینجا با مفهوم یکپارچه سازی دادهها و مراحل مختلف آن آشنا شدیم. حالا در این بخش، به معرفی انواع مختلف یکپارچهسازی دادهها میپردازیم و مزایا و معایب هرکدام را بررسی میکنیم.

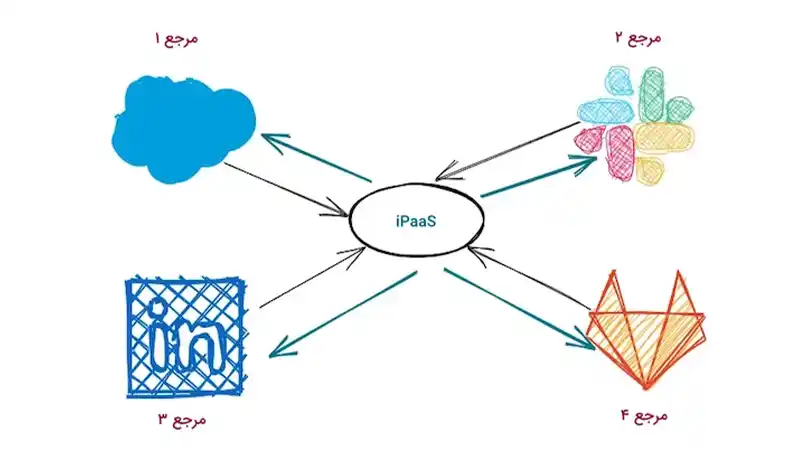

پلتفرم یکپارچهسازی به عنوان سرویس (iPaaS)

پلتفرم یکپارچهسازی به عنوان سرویس یا iPaaS، که مخفف عبارت Integration Platform as a Service است، در سال ۲۰۰۸ توسط شرکت Boomi معرفی شد. این پلتفرم به کسبوکارها این امکان را میدهد که دادهها را بهصورت خودکار از منابع مختلف جمعآوری و یکپارچه کنند. در iPaaS، تمامی فرآیندها بر اساس محرکها (Triggers) فعال میشوند. به عبارت دیگر، زمانی که یک رویداد خاص مانند دریافت ایمیل یا پیام در شبکههای اجتماعی رخ میدهد، این رویداد باعث انجام یک یا چند عمل از پیش تعیینشده میشود. برای مثال، دریافت ایمیل میتواند بهعنوان محرکی باشد که پس از آن پیام خوانده شده و وضعیت آن بهروزرسانی میشود.

iPaaS نه تنها برای انتقال دادهها بین سیستمهای مختلف استفاده میشود، بلکه به کسبوکارها این امکان را میدهد که جریان دادهها را به راحتی مدیریت و نظارت کنند. این پلتفرمها معمولاً دارای رابط کاربری سادهای هستند که برای استفاده نیاز به دانش فنی خاصی ندارند.

از مزایای iPaaS میتوان به سهولت استفاده و کاهش نیاز به کدنویسی اشاره کرد، اما این پلتفرمها معمولاً محدودیتهایی دارند. هزینه این پلتفرمها معمولاً بر اساس تعداد عملیات محاسبه میشود و در جابهجایی دادههای رویدادمحور عملکرد بهتری دارند. به علاوه، به دلیل انعطافپذیری بالا، کاربران ممکن است با پیچیدگیهایی مواجه شوند که نیاز به آموزش بیشتر داشته باشند.

در نهایت، iPaaS بهعنوان یک راهحل یکپارچهسازی در شرایط خاص مؤثر است، اما ممکن است برای تمام نیازهای پیچیده یکپارچهسازی مناسب نباشد.

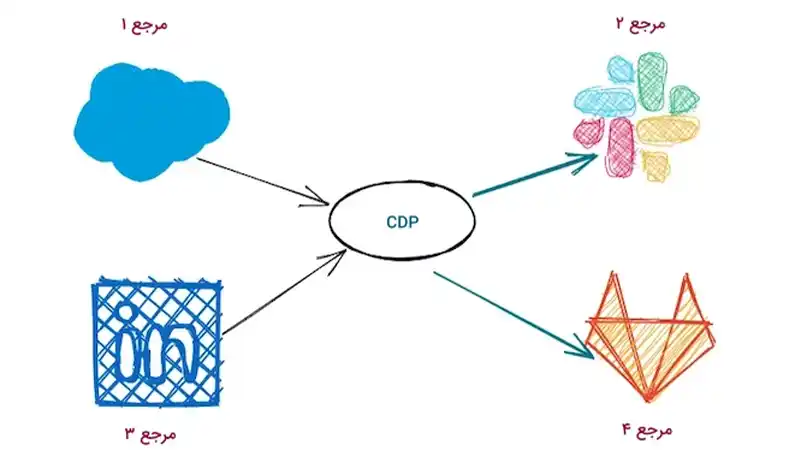

پلتفرم دادههای کاربر (CDP)

پلتفرم دادههای کاربر یا CDP (Customer Data Platform) به سیستمهایی اطلاق میشود که دادههای کاربران را از منابع مختلف جمعآوری کرده و آنها را به مقاصد مختلف ارسال میکنند. یکی از ویژگیهای بارز CDP این است که امکان جمعآوری دادهها از طریق ابزارهایی مانند کیتهای توسعه نرمافزار (SDKs) و رابطهای برنامهنویسی اپلیکیشن (APIs) نیز فراهم است. این پلتفرمها در سالهای اخیر مورد استقبال زیادی قرار گرفتهاند و در صنایع مختلف بهویژه در بخشهای بازاریابی، نقش پررنگی ایفا میکنند.

پلتفرمهای CDP بیشتر از اینکه بر یکپارچهسازی دادهها تمرکز کنند، بر انتقال دادهها بین ابزارها و سیستمهای مختلف متمرکز هستند. این پلتفرمها معمولاً بر اساس مدلهای داده از پیش تعریف شده عمل میکنند و معمولاً همکاری محدودی با منابع خارجی دارند. به همین دلیل، CDP کمتر برای یکپارچهسازی گسترده دادهها استفاده میشود.

مهمترین کاربردهای CDP در این است که به تیمهای بازاریابی این امکان را میدهد تا با استفاده از دادههای جمعآوری شده، تجربه شخصیسازیشدهای برای کاربران ایجاد کنند. این پلتفرمها به کسبوکارها این امکان را میدهند که بخشهایی از دادهها را بر اساس رفتار کاربران ایجاد کرده و به این ترتیب تجربه بهتری برای آنها فراهم کنند

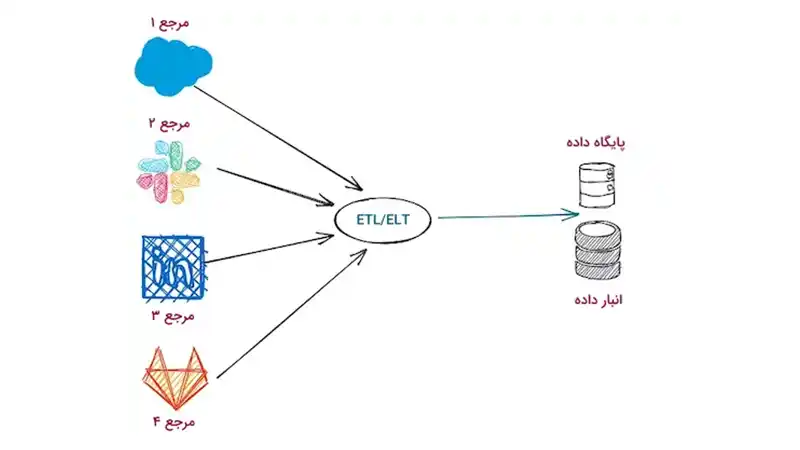

استخراج، تغییر و بارگذاری یا ETL

رویکرد استخراج، تغییر و بارگذاری (ETL) به سال ۱۹۷۰ بازمیگردد، اما تنها در اوایل دهه ۹۰ میلادی بود که این روش در صنعت دادهها مطرح شد. در مدل ETL، ابتدا دادهها از منابع مختلف جمعآوری میشوند؛ این منابع میتوانند شامل پایگاههای داده دست اول (First-party) و دستگاههای دست سوم (Third-party) باشند. سپس دادهها تحت فرایند تغییر قرار میگیرند تا به فرمت و استانداردی که تحلیلگران و دانشمندان داده به آن نیاز دارند تبدیل شوند. در نهایت، این دادهها در یک انبار داده ذخیره میشوند تا برای تجزیه و تحلیلهای آینده در دسترس قرار گیرند.

فرایند تغییر یا Transformation در ETL به منابع زیادی نیاز دارد و معمولاً بسیار زمانبر است. این ویژگی باعث میشود که کل فرایند استخراج و بارگذاری کند و کندتر انجام شود. به همین دلیل، با پیشرفت در زمینه انبار دادهها و نیاز به رویکردهای سریعتر و انعطافپذیرتر، مدل ELT (Extract, Load, Transform) بهعنوان جایگزینی برای ETL معرفی شد. ELT این امکان را فراهم میکند که تغییرات بعد از بارگذاری دادهها انجام شوند، که نتیجه آن سرعت بیشتر و انعطافپذیری بهتر در فرایندهای دادهای است.

استخراج، بارگذاری و تغییر یا ELT

روش استخراج، بارگذاری و تغییر (ELT) نسخه بهروز شده و پیشرفتهتری از رویکرد ETL است که با افزایش سرعت و پایداری انبارهای داده ابری به محبوبیت زیادی رسیده است. یکی از مزایای اصلی ELT، انعطافپذیری آن است که از جداسازی بخش محاسبات از ذخیرهسازی بهره میبرد. این ویژگی کمک کرده تا ELT در بسیاری از صنایع و کاربردها موفقیتهای چشمگیری کسب کند.

در مدل ELT، دادهها ابتدا از سیستم مرجع استخراج میشوند و بدون هیچ تغییری به انبار داده منتقل میشوند. سپس تغییرات و تبدیلها پس از بارگذاری در انبار داده اعمال میشوند. این رویکرد علاوهبر سرعت و کارایی بیشتر، از نظر هزینه نیز مقرونبهصرفهتر است. یکی از ویژگیهای برجسته ELT این است که نیازی به کدنویسی پیچیده ندارد، که این امر موجب سهولت استفاده و کاهش نیاز به منابع فنی برای اجرای آن میشود.

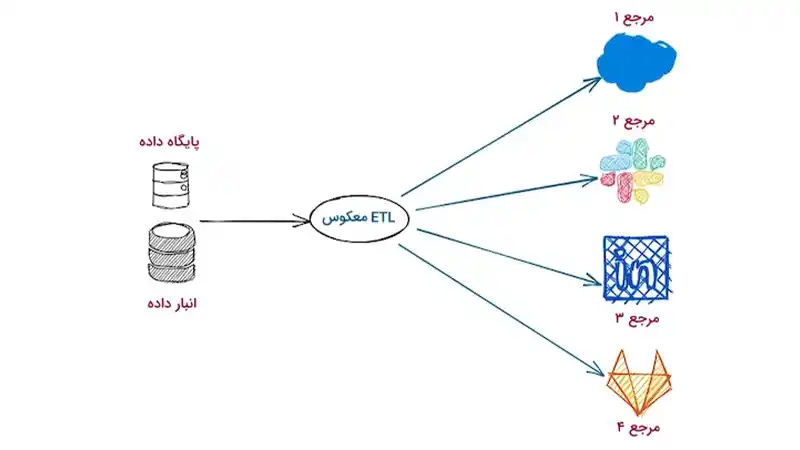

ETL معکوس

ETL معکوس (Reverse ETL) رویکردی است که از انبار داده به سیستمهای عملیاتی و سایر منابع داخلی و خارجی دادهها را بازمیگرداند. این ابزارهای جدید برای یکپارچهسازی دادهها با استفاده از روشهای ELT ساخته شدهاند و توانایی تغییر دادهها در انبارهای داده را بهمنظور ارائه دادههای قابل استفاده برای بخشهای مختلف سازمان فراهم میکنند. این قابلیتها ارزش زیادی را به دادههای پراکنده در سیستمهای داخلی و خارجی میدهند.

برخی از کاربردهای ETL معکوس عبارتند از:

- استخراج دادهها از انبار داده و ارسال آنها به ابزارهای مختلف مانند سیستمهای آماری، بازاریابی و فروش برای تحلیل و استفاده عملی.

- ارسال محرکها یا درخواستها به سرویسهای API پس از هر تغییر در دادهها.

- انتقال سطرهای داده به مخازن عملیاتی بهمنظور اهداف خاص و استفاده در عملیات روزمره.

یکی از ویژگیهای برجسته ETL معکوس این است که بهخوبی از دادههای تمیز و ذخیرهشده در انبار داده استفاده میکند و آنها را به سرویسهای ابری منتقل میکند تا مهندسان داده بتوانند یک سیستم واحد برای پردازش و اجرا در اختیار سایر بخشها قرار دهند.

این رویکرد، کمک شایانی به فرآیندهای یکپارچهسازی دادهها میکند و به شرکتها این امکان را میدهد تا دادهها را بهطور مؤثرتر و کارآمدتری در بین سیستمها و ابزارهای مختلف منتقل کنند.

ابزارهای یکپارچهسازی دادهها

ابزارهای یکپارچهسازی دادهها در گذشته نیازمند توسعهدهندگانی بودند که با زبانهای برنامهنویسی و SQL آشنایی داشتند. اما امروزه با پیشرفت فناوری، ابزارهای متنوعی برای یکپارچهسازی دادهها، از جمله راهکارهای متنباز و پلتفرمهای اختصاصی، برای خودکارسازی و مستندسازی فرایندهای دادهای عرضه میشود. این ابزارها به طور کلی شامل موارد زیر هستند:

ابزارهای ETL: برای استخراج دادهها از منابع مختلف، تغییر آنها به فرمت مناسب و ذخیرهسازی در سیستمهایی مانند انبار دادهها استفاده میشوند.

گذرگاه سرویس سازمانی (ESB) و میانافزار: این ابزارها زیرساختهای ارتباطی را فراهم میکنند و یکپارچهسازی نرمافزارها و سرویسها را تسهیل میکنند. ویژگیهایی مانند تبادل بلادرنگ دادهها و مدیریت API از جمله قابلیتهای این ابزارهاست.

ابزارهای تکثیر داده: برای همگامسازی مکرر دادهها از سیستم مبدا به هدف، استفاده میشود و در موقعیتهای اضطراری و یکپارچهسازی بلادرنگ کاربرد دارد.

ابزارهای مجازیسازی داده: این ابزارها امکان دسترسی به دادهها بدون جابهجایی فیزیکی آنها را فراهم میکنند و تنها یک نمای مجازی از منابع مختلف ارائه میدهند.

iPaaS: این پلتفرمها برای یکپارچهسازی ابری، مدیریت API و مسیریابی اطلاعات در محیطهای مختلف سازمانی کاربرد دارند.

ابزارهای دادههای جریانی: برای پردازش دادههای بلادرنگ از منابعی مانند IoT، سنسورها و شبکههای اجتماعی به کار میروند.

ابزارهای نظارت و کیفیت داده: این ابزارها برای تضمین کیفیت دادههای جمعآوریشده از منابع مختلف استفاده میشوند و شامل ویژگیهایی مانند تمیزسازی و مدیریت فرادادهها هستند.

ابزارهای CDC: برای شناسایی و بازسازی تغییرات بلادرنگ دادهها، بهویژه در انبارهای داده و تحلیل آنی کاربرد دارند.

این ابزارها به سازمانها کمک میکنند تا دادهها را بهطور مؤثر و بهینه یکپارچهسازی کنند.

مثال هایی از یکپارچه سازی داده

در ادامه چند مثال از پروژههای مختلف یکپارچهسازی دادهها آورده شده است که میتواند نمایشی از نحوه استفاده از این فرایند در دنیای واقعی باشد:

یکپارچهسازی دادههای مشتری در سیستمهای بازاریابی

یکپارچهسازی دادههای مشتری در بازاریابی یکی از کاربردهای کلیدی این فرآیند است. این کار با هدف تجمیع و همسانسازی تمامی دادههای مشتری از منابع مختلف انجام میشود. بهعنوان مثال، اطلاعات تماس، جزئیات حساب کاربری، امتیازات محصولات و تعاملات مختلف مانند پستها و کامنتهای منتشر شده در شبکههای اجتماعی، همگی در یک سیستم یکپارچه جمعآوری میشوند.

این یکپارچهسازی دادهها کمک میکند تا کسبوکارها نمایی جامع از رفتار مشتریان خود به دست آورند. از آنجا که تمامی اطلاعات در یک پلتفرم واحد ذخیره میشوند، تیمهای بازاریابی میتوانند تحلیل دقیقتری از نیازها و علایق مشتریان داشته باشند و استراتژیهای بازاریابی خود را بر اساس این دادهها تنظیم کنند. این اطلاعات میتواند به بهبود تجربه مشتری، شخصیسازی پیامهای تبلیغاتی و بهینهسازی کمپینهای بازاریابی کمک کند، در نتیجه ارتباطات مؤثرتر و تجربه کاربری بهتری برای مشتریان فراهم میآید.

یکپارچهسازی دادههای حسگرهای IoT

یکپارچهسازی دادههای حوزه اینترنت اشیاء (IoT) در حال تبدیل شدن به یکی از اولویتهای اصلی سازمانها است. بهویژه در بخشهایی مانند تجهیزات صنعتی، اتومبیلها و آسانسورها که از سنسورهای متصل به اینترنت برای جمعآوری دادهها استفاده میکنند. این دادهها میتوانند اطلاعات ارزشمندی از وضعیت تجهیزات و عملکرد آنها فراهم کنند.

سازمانها با یکپارچهسازی این دادهها میتوانند تحلیلهای پیشرفتهای انجام دهند و شبیهسازیهای پیشگیرانه پیادهسازی کنند. این فرایند به کسبوکارها این امکان را میدهد که مشکلات بالقوه را پیشبینی کرده و اقدامات اصلاحی را پیش از وقوع مشکل انجام دهند. نتیجه این کار کاهش زمان توقف ناشی از مشکلات ناگهانی است، که به صرفهجویی در هزینهها و بهبود کارایی عملیاتی منجر میشود. این یکپارچهسازی میتواند تأثیر زیادی در بهبود تصمیمگیریها و ارتقای بهرهوری در محیطهای صنعتی و تجاری داشته باشد.

یکپارچه سازی داده در کاربرد های فروشگاهی

یکپارچهسازی دادهها در کاربردهای فروشگاهی به ویژه در فروشگاههای سنتی و آنلاین که با حجم بالای دادهها سروکار دارند، اهمیت زیادی پیدا کرده است. برای استفاده بهینه از این دادهها، فروشندگان نیاز دارند تا اطلاعات جمعآوری شده را در یک سیستم متمرکز کنند. با این کار، آنها میتوانند به راحتی به مدیریت جنبههای مختلف کسبوکار مانند انبارداری، ساعات کاری کارکنان، درآمد و دیگر متغیرهای مهم بپردازند.

یکپارچهسازی دادهها به فروشندگان این امکان را میدهد که از اطلاعات جمعآوری شده از سیستمهای مختلف، مانند سیستمهای فروش، مدیریت موجودی و تحلیلهای مشتری، استفاده کنند. این فرآیند میتواند به بهبود تصمیمگیریها در زمان واقعی، بهینهسازی استراتژیهای فروش، و افزایش کارایی در سطح عملیاتی کمک کند. در نهایت، یکپارچهسازی دادهها به فروشگاهها کمک میکند تا به یک دید جامع از عملکرد خود دست یابند و تجربه خرید بهتری برای مشتریان فراهم کنند.

مزایا یکپارچه سازی داده ها چیست؟

مزایای یکپارچهسازی دادهها به سازمانها کمک میکند تا تصمیمات بهتری بگیرند، کارایی خود را افزایش دهند و از مزیتهای رقابتی بهرهمند شوند. در زیر به برخی از مهمترین مزایای این فرایند اشاره میشود:

- کاهش مخازن داده: با یکپارچهسازی دادهها، اطلاعات از منابع مختلف جمعآوری شده و در یک سیستم متمرکز و جامع نمایش داده میشود. این امر موجب کاهش تعداد مخازن داده میشود و افزونگی و ناپایداری ناشی از منابع مختلف را از بین میبرد.

- بهبود کیفیت داده: یکپارچهسازی دادهها شامل فرآیندهایی مانند تغییر، پاکسازی و تصحیح دادهها است که باعث شناسایی و رفع خطاهای داده میشود و کیفیت دادهها را بهبود میبخشد.

- بهبود کارایی: با یکپارچهسازی دادهها، نیاز به وارد کردن دستی اطلاعات و اجرای فرآیندهای تکراری کاهش مییابد. این موضوع باعث افزایش کارایی، کاهش خطاها و بهبود پایداری دادهها میشود.

- افزایش سرعت عمل: یکپارچهسازی دادهها امکان دسترسی سریعتر به اطلاعات را فراهم میکند. سرعت بالا در واکنش به نیازهای مشتری و تصمیمگیریهای تجاری امری ضروری است که با این فرآیند بهبود مییابد.

- ارتقا هوش تجاری: یکپارچهسازی دادهها پایه و اساس بسیاری از فعالیتهای هوش تجاری است. ابزارهای تجزیه و تحلیل نیاز به دادههای یکپارچه دارند تا بتوانند اطلاعات قابل استفاده و معناداری استخراج کنند.

- نوآوریهای دادهمحور: با استفاده از دادههای یکپارچه، سازمانها میتوانند الگوها و فرصتهایی را شناسایی کنند که ممکن است بهسادگی قابل مشاهده نباشند. این امر به ایجاد محصولات و خدمات جدید و افزایش نوآوری در سازمان کمک میکند.

چالش های یکپارچه سازی داده ها

چالشهای یکپارچهسازی دادهها بهویژه در فرآیندهای پیچیدهای که نیازمند دقت و کارایی بالایی هستند، میتواند تاثیر زیادی بر کارآمدی و کیفیت نتایج داشته باشد. برخی از رایجترین چالشها عبارتند از:

- سازگاری و چالش فرمت: هر مجموعهداده معمولاً فرمت و ساختار خاص خود را دارد. استانداردسازی دادهها برای سازگار کردن آنها با یکدیگر فرآیندی زمانبر و پیچیده است که نیاز به تلاش فراوان دارد.

- امنیت و حریم خصوصی: هنگام کار با دادههای حساس، رعایت اصول امنیتی و قوانین حریم خصوصی از اهمیت ویژهای برخوردار است. در صورت عدم رعایت این موارد، سازمانها با خطرات جدی امنیتی و حقوقی مواجه خواهند شد.

- حجم و تنوع دادهها: با توجه به رشد روزافزون دادهها، یکپارچهسازی دادههای کلان (Big Data) که تنوع زیادی دارند و نیاز به پردازش سریع دارند، به یکی از بزرگترین چالشها تبدیل شده است.

- یکپارچهسازی سیستمهای قدیمی: در بسیاری از سازمانها، سیستمهای قدیمی که فاقد قابلیتهای مدرن مانند دسترسیهای API هستند، امکان هماهنگی و یکپارچهسازی با سیستمهای جدید را ندارند. این مسئله میتواند موانعی در فرآیند یکپارچهسازی ایجاد کند.

با غلبه بر این چالشها، سازمانها قادر خواهند بود دادههای یکپارچهای ایجاد کنند که میتواند در بهبود عملکرد سیستمها و حتی توسعه مدلهای یادگیری ماشین موثر باشد.

کاربرد یکپارچه سازی داده ها چیست؟

یکپارچهسازی دادهها کاربردهای گستردهای در صنایع مختلف دارد که به کسبوکارها کمک میکند تا از دادههای پراکنده به بهترین شکل استفاده کنند. برخی از مهمترین کاربردهای یکپارچهسازی دادهها عبارتند از:

- انبارداری دادهها: یکی از کاربردهای اصلی یکپارچهسازی دادهها، ساخت انبار دادهها است. این فرایند امکان ذخیرهسازی و مدیریت دادهها را در یک سیستم متمرکز فراهم میکند که در تحلیلهای بعدی و تصمیمگیریهای کسبوکار استفاده میشود.

- توسعه دریاچه دادهها: دادهها در محیطهای کلان داده معمولاً از انواع مختلفی تشکیل میشوند؛ از جمله دادههای ساختیافته، غیر ساختیافته و نیمه ساختیافته. یکپارچهسازی این دادهها و انتقال آنها به دریاچه داده (Data Lake) امکان استفاده از تکنیکهای پیشرفته مانند هوش مصنوعی و یادگیری ماشین برای استخراج اطلاعات مفید از این دادهها را فراهم میآورد.

- تشخیص نیاز مشتری: با یکپارچهسازی دادههای مختلف مشتری از منابع گوناگون، کسبوکارها میتوانند بهطور دقیق نیازهای خاص هر مشتری را شناسایی کنند. این اطلاعات به شرکتها کمک میکند تا فرصتهای جدیدی ایجاد کنند و تجربهای شخصیسازیشده برای مشتریان خود فراهم کنند.

- گزارشدهی: یکپارچهسازی دادهها نقش مهمی در تولید گزارشهای جامع از عملکرد کسبوکار، فروش، بازاریابی و امور مالی دارد. این گزارشها میتوانند تصمیمگیریهای سریع و موثر را تسهیل کنند.

- پردازش دادههای مربوط به IoT: کسبوکارها میتوانند با یکپارچهسازی دادههای جمعآوری شده از دستگاههای اینترنت اشیا (IoT) به تحلیل و پردازش این دادهها پرداخته و از آنها برای مدیریت سرویسهای متصل، بهینهسازی عملکرد و خودکارسازی فرآیندها استفاده کنند.

این کاربردها نشان میدهند که یکپارچهسازی دادهها در ایجاد فرصتهای جدید و بهبود کارایی کسبوکارها نقش اساسی دارد.

جمعبندی

یکپارچهسازی دادهها امروزه به یکی از اصول اساسی در صنایع مختلف تبدیل شده است. این فرایند به سازمانها کمک میکند تا از دادههای پراکنده در منابع مختلف بهرهبرداری کنند و آنها را بهصورت متمرکز و یکپارچه ذخیره کنند. در این مطلب، با مفاهیم مختلف یکپارچهسازی دادهها، ابزارها و تکنیکهای کاربردی آن آشنا شدیم و دیدیم که این فرایند چگونه میتواند در بهبود کارایی، تصمیمگیریهای آگاهانه و ارائه خدمات بهتر به مشتریان تاثیرگذار باشد.

با توجه به تنوع تکنیکها و ابزارهای موجود، انتخاب مناسبترین روش یکپارچهسازی دادهها بستگی به نیاز خاص هر سازمان و نوع دادهها دارد. در نهایت، با بهرهگیری از این ابزارها و تکنیکها، سازمانها میتوانند مزیت رقابتی خود را حفظ کرده و عملکرد بهتری داشته باشند.