متا بزرگترین مدل هوش مصنوعی منبع باز خود، Llama 3.1 را معرفی میکند

مقالهای که پیشروی شماست، بهطور کامل به مدل جدید و پیشرفته Llama 3.1 از شرکت متا میپردازد؛ مدلی که بهعنوان یکی از بزرگترین و نوآورانهترین مدلهای هوش مصنوعی متنباز شناخته میشود. در این مقاله، ابتدا با قابلیتها و ویژگیهای Llama 3.1-405B آشنا میشوید و درمییابید که چگونه این مدل در مقایسه با سایر مدلهای پیشرو بازار، عملکرد خیرهکنندهای از خود نشان میدهد.

در ادامه، مقاله به بررسی روشهای استفاده بهینه از این مدل میپردازد و توضیح میدهد که Llama 3.1 چگونه میتواند در تولید داده مصنوعی و تقطیر دانش به سازمانها کمک کند. همچنین در بخش دیگری از مقاله، نکاتی درباره ابزارهایی چون HuggingChat، Poe و watsonx آمده است که به کاربران امکان استفاده رایگان و غیررایگان از این مدل فوقالعاده را میدهند.

اگر به دنبال آن هستید که Llama 3.1 را برای کسبوکارتان به کار بگیرید، این مقاله شما را با راهکارهای سفارشیسازی و پیادهسازی این مدل در IBM watsonx آشنا میکند. در انتها، جدیدترین قابلیتهای این مدل برای استفاده در چتباتهای آیندهنگر معرفی شده که شامل ویژگیهایی است که استفاده از هوش مصنوعی را در آینده برای کاربران شخصیسازی میکند.

در روز سهشنبه، ۲ مرداد، شرکت متا از عرضه مدلهای زبان بزرگ چند زبانه (LLM) تحت عنوان Llama 3.1 خبر داد. Llama 3.1 شامل مدلهای هوش مصنوعی مولد است که بهصورت متنباز و منبعباز ارائه شده و در نسخههای ۸ میلیارد، ۷۰ میلیارد و برای اولین بار با حجم چشمگیر ۴۰۵ میلیارد پارامتر منتشر شده است.

مدل ۴۰۵ میلیارد پارامتری Llama 3.1 نه تنها یکی از بزرگترین مدلهای زبان منبعباز حال حاضر محسوب میشود، بلکه قدرتی رقابتی در برابر بهترین مدلهای تجاری نیز ارائه میدهد. این مدل از طریق پلتفرم watsonx.ai در فضای ابری IBM و همچنین در محیطهای ترکیبی ابری و محلی در دسترس کاربران قرار گرفته است.

عرضه Llama 3.1 در ادامه انتشار مدلهای Llama 3 در ۱۸ آوریل انجام میشود. متا اعلام کرده است که در آینده نزدیک قصد دارد Llama 3 را به یک مدل چندزبانه و چندوجهی تبدیل کند تا با پوششدهی دامنههای وسیعتر و بهبودهایی در زمینه استدلال و کدنویسی، عملکرد کلی آن را تقویت کند.

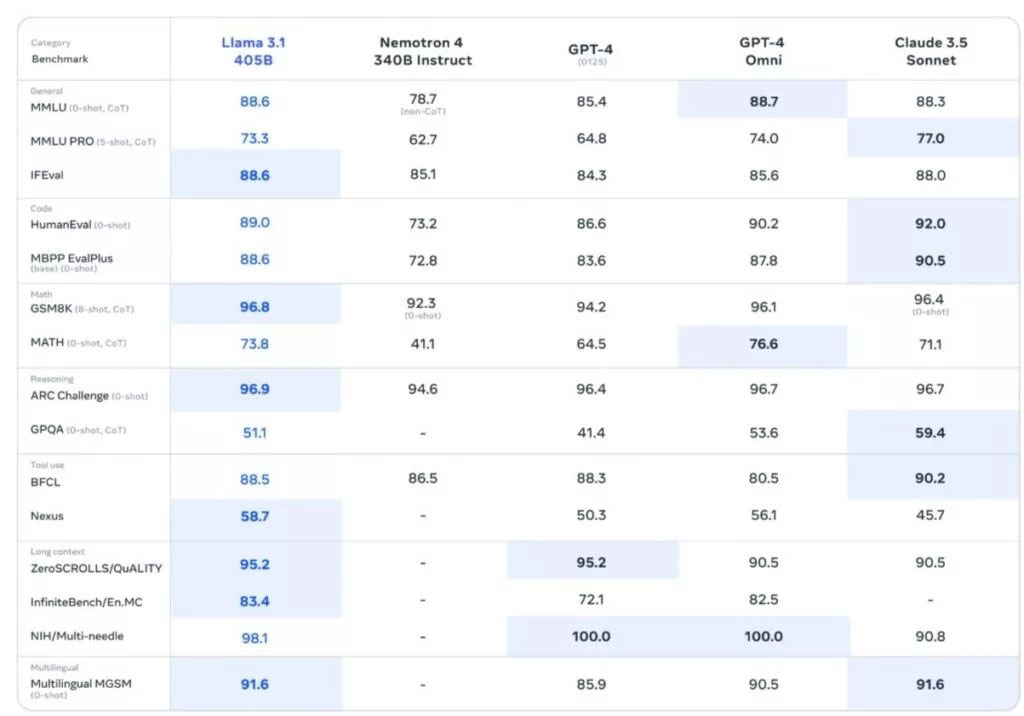

به گفته متا، این مدل در چندین آزمون بنچمارک، عملکردی بالاتر از GPT-4o و Claude 3.5 Sonnet از خود نشان داده است. مارک زاکربرگ، مدیرعامل متا، پیشبینی میکند که این مدل هوش مصنوعی تا پایان سال ۲۰۲۴ پرکاربردترین دستیار AI خواهد شد و حتی از ChatGPT نیز پیشی خواهد گرفت. Llama 3.1 همچنین مورد تحسین ایلان ماسک، مدیرعامل تسلا و xAI، نیز قرار گرفته است.

گزارشها از ورج حاکی از آن است که Llama 3.1 از مدلهای کوچکتر سری Llama 3 بهمراتب پیچیدهتر است. این مدل با ۴۰۵ میلیارد پارامتر و با بهرهگیری از بیش از ۱۶ هزار پردازشگر قدرتمند H100 انویدیا آموزش داده شده است. اگرچه متا هزینه دقیق توسعه این مدل را اعلام نکرده، اما به دلیل قیمت بالای این تراشهها، احتمالاً هزینههای متا به صدها میلیون دلار رسیده است.

برای استفاده از انواع هوش مصنوعی ویدئو ساز کلیک کنید.

هوش مصنوعی منبع باز جدید متا، Llama 3.1

مدل Llama 3.1 متا یک پیشرفت بزرگ در مسیر اهداف آینده متا است که شامل افزایش طول متن، پشتیبانی گسترده از زبانهای مختلف و بهرهگیری از ابزارهای چندزبانه میشود.

در دسامبر ۲۰۲۳، متا و IBM با همکاری بیش از ۵۰ عضو جهانی اتحاد هوش مصنوعی را شکل دادند. هدف این اتحاد، گردهم آوردن سازمانهای پیشرو، استارتاپها، دانشگاهها و نهادهای دولتی برای شکلدهی به آینده هوش مصنوعی و انطباق آن با نیازهای جامعه است. این اتحاد تاکنون به بیش از ۱۰۰ عضو رسیده و قصد دارد با ایجاد فضایی باز، توسعهدهندگان و محققان را به نوآوری مسئولانه تشویق کند، در حالی که امنیت، تنوع، دقت علمی و رقابت اقتصادی را نیز تضمین میکند. این اتحاد با حمایت از پروژههای متنباز و توسعه استانداردهای ارزیابی، نقش مهمی در رشد هوش مصنوعی ایفا میکند.

Llama 3.1 نیز این مأموریت را ادامه میدهد و با ارائه یک اکوسیستم پیشرفته به جامعه هوش مصنوعی امکان ساخت، آزمایش و ارتقاء پروژهها را فراهم میکند. این نسخه شامل اقدامات ایمنی تقویتشده، استانداردهای امنیت سایبری و محافظتهای بهروزشده است که به بهبود اعتماد و ایمنی در هوش مصنوعی کمک میکند.

رابطه ایلان ماسک و مارک زاکربرگ همواره رقابتی بوده است؛ حتی ایلان ماسک یک بار زاکربرگ را به مبارزه دعوت کرد که او نیز پذیرفت! اما هر دو درباره اهمیت مدلهای متنباز هوش مصنوعی نظر مشترکی دارند. پس از معرفی Llama 3.1، ایلان ماسک در ایکس از زاکربرگ بهخاطر متنباز بودن این مدل تقدیر کرد. زاکربرگ معتقد است متنباز بودن مدلها برای آینده هوش مصنوعی امری ضروری است و میگوید هوش مصنوعی متنباز به دلیل نظارت گستردهتر ایمنتر خواهد بود.

زاکربرگ برای اثبات ارزش مدلهای متنباز، به لینوکس اشاره میکند که اکنون یک سیستمعامل محبوب و قدرتمند است. او همچنین پیشبینی میکند که تا پایان ۲۰۲۴، هوش مصنوعی متا پرمصرفترین چتبات جهان خواهد شد؛ برای مقایسه، ChatGPT اکنون بیش از ۱۰۰ میلیون کاربر دارد.

با وجود رایگان بودن استفاده از Llama 3.1، تعداد درخواستهای کاربران محدود است و پس از آن باید به مدل کوچکتر ۷۰ میلیاردی مراجعه کنند. همچنین قابلیت جدیدی به نام «Imagine Me» در Meta AI به کاربران امکان میدهد که با اسکن چهره خود تصاویر واقعگرایانهتری تولید کنند. از همین امروز، کاربران آمریکایی میتوانند از طریق واتساپ یا وبسایت meta.ai به تعامل با Llama 3.1 بپردازند و سوالات خود را از این مدل بپرسند.

مقایسه Llama 3.1-405B با مدلهای پیشرو بازار

مدلهای Llama 3.1 متا با بیش از ۴۰۰ میلیارد پارامتر، در معرفی اولیهی Llama 3 در ماه آوریل، عملکردی اولیه را نشان دادند، اما اندازه دقیق و مشخصات آنها تا عرضه نهایی مشخص نشده بود. مدل Llama 3.1-405B اکنون با مدلهای پیشرفته منبع بسته، رقابت میکند و در بسیاری از معیارها عملکردی همسطح یا برتر دارد.

براساس ارزیابیهای متا، مدل 405B در برابر مدلهای پیشرفته بازار به خوبی ظاهر شده است:

• دانش سطح کارشناسی (MMLU، ۵-شات): با امتیاز ۸۷.۳٪، Llama 405B در مقایسه با مدلهای معروفی همچون GPT-4-Turbo (۸۶.۵٪)، Claude 3 Opus (۸۶.۸٪) و گوگل جمینی ۱.۵ (۸۵.۹٪)، عملکردی نزدیک به آنها دارد.

• سطح استدلال (GPQA، ۰-شات): با امتیاز ۵۰.۷٪، Llama 405B در حد و اندازه Claude 3 Opus (۵۰.۴٪) ظاهر میشود و از Claude 3 Sonnet (۸۳.۷٪) و GPT-4 (۳۵.۷٪) برتر عمل میکند.

• درک مطلب (DROP، F1): امتیاز Llama 405B در این معیار (۸۴.۸) از GPT-4o (۸۳.۴) و Claude 3 Opus (۸۳.۱) بالاتر است، تنها از GPT-4T (۸۶.۰) و Claude 3.5 Sonnet (۸۷.۱) عملکرد کمتری دارد.

• پرسش و پاسخ (ARC-Challenge، ۲۵-شات): با امتیاز ۹۶.۱٪، Llama 405B عملکردی مشابه با GPT-4 (۹۶.۳٪) و Claude 3 Opus (۹۶.۴٪) دارد.

• کدنویسی (HumanEval، ۰-شات): Llama با امتیاز ۸۹.۰٪ از اکثر مدلها بهجز Claude 3.5 Sonnet و GPT-4o بهتر عمل میکند.

مدل 405B Llama 3.1 به عنوان یک مدل منبع باز، برتری مهمی نسبت به مدلهای منبع بسته دارد، چرا که بدون تغییرات ناگهانی در دسترس محققان و شرکتها قرار میگیرد و این موضوع به افزایش ثبات و قابلیت پیشبینی برای کاربران حرفهای کمک میکند.

Llama 3.1-405B بهطور قابل توجهی از Llama 3 پیچیدهتر است و از معماری ترانسفورمر استفاده میکند که تنها برای رمزگشایی به کار میرود. این مدل با بیش از ۱۶,۰۰۰ پردازشگر گرافیکی H100 انویدیا آموزش دیده است و اجرای رایگان آن برای کاربران محدودیت دارد، و پس از آن نسخه کوچکتر با ۷۰ میلیارد پارامتر در دسترس قرار میگیرد.

مدیرعامل متا، مارک زاکربرگ، پیشبینی کرده که هوش مصنوعی Meta AI، که بر پایه مدلهای Llama است، تا پایان ۲۰۲۴ پرکاربردترین چتبات خواهد بود و از ChatGPT پیشی خواهد گرفت. همچنین، کاربران میتوانند با استفاده از قابلیت «Imagine Me»، از طریق دوربین سلفی، تصاویری شبیه به خود ایجاد کنند. همکاری متا با شرکتهایی همچون مایکروسافت، آمازون، گوگل و انویدیا به کاهش هزینههای اجرای Llama 3.1 کمک کرده و طبق ادعای متا، این مدل نصف GPT-4o هزینهبر است.

با وجود هزینه سنگین توسعه این مدل که احتمالاً به صدها میلیون دلار میرسد، زاکربرگ بر این باور است که مدلهای متنباز مانند Llama 3.1 به سرعت از مدلهای خصوصی پیشی خواهند گرفت. او با مقایسه این مدل با پروژه Open Compute، که چندین میلیارد دلار برای متا صرفهجویی به همراه داشت، میگوید:

“معتقدم انتشار Llama 3.1 به یک نقطه عطف در هوش مصنوعی تبدیل میشود و توسعهدهندگان بیشتری به استفاده از برنامههای متنباز روی میآورند.”

چطور بهترین استفاده را از Llama-3.1-405B ببریم؟

Llama-3.1-405B با پارامترهای پیشرفته و قابلیتهای بینظیر، فرصتهای گستردهای را برای کاربران، بهویژه در پروژههای متنباز، فراهم کرده است. در دسترس بودن این مدل برای توسعهدهندگان و پژوهشگران، نوآوریهای جدیدی را در بازار هوش مصنوعی تسریع میبخشد. در ادامه، به کاربردهای خاص و روشهای بهینه استفاده از این مدل میپردازیم.

۱. استفاده از مدل برای تولید دادههای مصنوعی

مدل 405B میتواند دادههای مصنوعی باکیفیتی تولید کند که بهویژه در زمانی که دادههای واقعی کمیاب یا پرهزینه هستند، مفید است. به عنوان مثال، این دادههای مصنوعی میتوانند در بهروزرسانی و تنظیم مدلهای کوچکتر یا در آموزش مدلهای جدیدتر به کار گرفته شوند.

۲. تقطیر دانش به مدلهای کوچکتر

یکی از کاربردهای برجسته Llama 405B، تقطیر دانش آن به مدلهای کوچکتر مانند 8B یا 70B است. این روش باعث میشود که تواناییهای پیشرفته مدل بزرگتر به مدلهای کوچکتر منتقل شود و در عین حال، سرعت و هزینه استنتاج کاهش یابد.

۳. تنظیم دقیق و آموزش مدل در دامنههای خاص

برخلاف مدلهای منبع بسته، Llama 3.1-405B بهطور کامل قابل تنظیم است. این یعنی میتوان آن را با استفاده از دادههای جدید و در دامنههای خاص برای کاربردهای متنوع آموزش داد. این قابلیت به کاربران اجازه میدهد مدل را برای کاربردهای سفارشیسازی شده بهینه کنند.

۴. بهرهگیری از پلتفرمهای پیشنهادی مانند IBM® watsonx

پلتفرمهای حرفهای همچون IBM watsonx که ویژگیهایی مانند ارزیابی مدل و بازیابی نسل افزوده (RAG) را ارائه میدهند، به کاربران کمک میکنند تا از مدل Llama 3.1 به شکل کارآمدتر استفاده کنند. این ابزارها ایمنی مدل را تضمین کرده و به مدیریت نتایج کمک میکنند.

۵. استفاده از چتباتها و پلتفرمهای واسط

پلتفرمهایی مانند HuggingChat و Poe راههای مناسبی برای دسترسی به مدلهای متنوع AI هستند. HuggingChat دسترسی رایگان به مدلهای متعدد را فراهم میکند و برای کاربران عادی مناسب است. در مقابل، Poe که توسط Quora توسعه یافته، با دریافت امتیازهای روزانه دسترسی به مدلها را فراهم میکند؛ البته در استفاده از مدل 405B به اشتراک پریمیوم نیاز است.

۶. دسترسی از طریق موتور جستجوی Perplexity

Perplexity، با قابلیت خلاصهسازی نتایج جستجو، گزینهای پیشرفته برای دسترسی به مدل Llama 3.1-405B ارائه میدهد. این ابزار به کاربران اجازه میدهد نتایج جستجو را به شکل بهینه مشاهده کرده و به اطلاعاتی مشابه راهنماهای ویکیپدیایی دسترسی داشته باشند؛ هرچند که برای استفاده از این مدل در Perplexity به اشتراک پولی نیاز است.

Llama 3.1-405B با فراهم کردن امکانات منحصربهفرد در زمینه تولید دادههای مصنوعی، تنظیم دقیق مدل و تقطیر دانش، به ابزاری اساسی برای توسعهدهندگان تبدیل شده است.

شروع کار با Llama 3.1

Llama 3.1، جدیدترین مدل هوش مصنوعی متا، برای تنظیم دقیق و استفاده سفارشیسازیشده طراحی شده است و امکانات بسیاری را برای کاربرانی که به دنبال بهرهبرداری از هوش مصنوعی منبع باز هستند، فراهم میکند. متا با ارائه این نسخه و با همکاری IBM در پلتفرم watsonx، در مسیر ایجاد دسترسی گستردهتر به مدلهای AI پیشرفته گام بزرگی برداشته است. این مدلها به کسبوکارها و توسعهدهندگان کمک میکنند تا مدلهای هوش مصنوعی را به شکل متناسب با نیازهای خاص خود پیادهسازی و سفارشی کنند.

امکانات و قابلیتهای ویژه IBM watsonx برای مدلهای Llama

پلتفرم watsonx از IBM به کاربران امکان میدهد که مدلهای Llama 3.1 را در محیطهای مختلفی اجرا کنند، چه در فضای ابری و چه در محیطهای محلی. این انعطافپذیری به همراه ابزارهای بصری و حرفهای برای تنظیم دقیق مدل و ادغام سریع با برنامههای کاربردی، آن را به گزینهای ایدهآل برای سازمانها و کسبوکارهایی که به دنبال سفارشیسازی و مدیریت جریانهای کاری AI هستند، تبدیل کرده است. Llama 3.1-405B هماکنون در watsonx.ai در دسترس است، و مدلهای کوچکتر (8B و 70B) نیز به زودی اضافه خواهند شد.

محدودیتها و ویژگیهای جدید متا AI

با اینکه استفاده از Llama 3.1 به صورت رایگان است، متا برای کنترل بار سرور، تعداد درخواستهای قابلارسال به مدل را محدود کرده است. همچنین قابلیت جدید Imagine Me به کاربران اجازه میدهد تا با اسکن چهره خود، تصاویری تولید کنند که با ظاهر آنها همخوانی دارد. زاکربرگ، مدیرعامل متا، پیشبینی کرده است که این فناوری تا پایان سال 2024 یکی از پرطرفدارترین چتباتهای هوش مصنوعی خواهد شد و توانایی رقابت با پلتفرمهایی مثل ChatGPT را دارد.

با Llama 3.1، کاربر میتواند از قابلیتهای پیشرفته یک مدل AI برای رفع نیازهای خاص کسبوکار خود بهره ببرد و برنامههای کاربردی هوش مصنوعی سفارشی بسازد، همه این امکانات در watsonx که یک پلتفرم یکپارچه برای مدیریت و سرعتبخشی به پروژههای AI است، به سادگی فراهم شدهاند.